En toen bleek de tijd rijp voor een ‘nieuwe’ 3D-visiontechniek: lightfield camera’s. Want hoewel het principe al enige tijd bekend was, was het vooral de rekenkracht die vooralsnog ontbrak. Gelukkig stelde ook hier de wet van Moore niet teleur. Op Vision, Robotics & Mechatronics 2014 toonde Dr. Christian Perwass van Raytrix Gmbh wat lightfield technologie voor de serieuze 3D-fan in petto heeft.

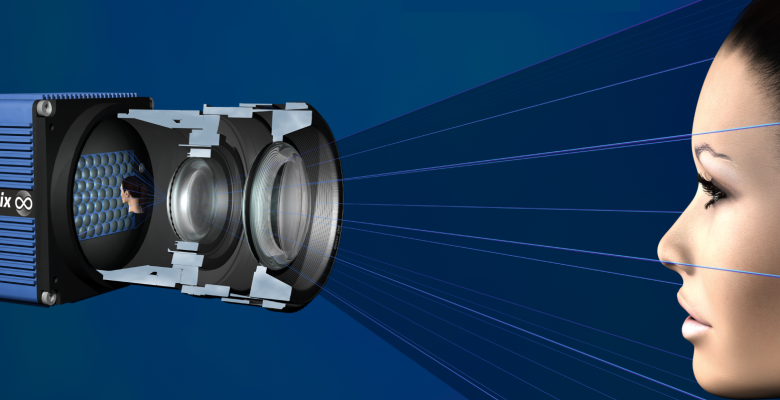

Stel je het volgende voor. In plaats van een ‘normale’ lens met een specifieke brandpuntsafstand, nemen we nu een lens die eigenlijk bestaat uit 40.000 microlensjes. Deze lensjes verdelen we in 20.000 lensparen, waarbij elk paar in feite een stereovisie beeld geeft. Zorg er bovendien voor dat in de microlensarray niet 1 type, maar bijvoorbeeld 3 typen microlenzen zitten met een verschillende brandpuntsafstand en je hebt een zee aan 3D informatie tot je beschikking. Deze moet je natuurlijk nog wel even goed aan elkaar knopen met de juiste beeldverwerkingssoftware en algoritmes. Laat dit nu net zijn waar Raytrix erg goed in is. Sinds 2009 maakt en verkoopt het Duitse bedrijf Lightfield camera’s en software waarmee de depth-of-field volgens eigen zeggen maarliefst 6 keer hoger ligt dan bij andere op de markt zijnde systemen, zonder dat er te veel concessies aan de effectieve resolutie gedaan hoeft te worden.

Historisch perspectief

Even uitzoomen naar het begin. En dat is een behoorlijk stukje. Het plenoptics-verhaal begint namelijk met natuurkundig Nobelprijswinnaar Gabriel Lippmann. Het is 1908 om precies te zijn. Lippmann is net wereldberoemd geworden omdat hij ’s-werelds eerste kleurenfoto’s heeft gemaakt. Hij kreeg dit voor elkaar door op een slimme manier gebruik te maken van de interferentie van licht en het leverde hem een Nobelprijs op. Minder bekend is dat de in 1845 in Luxemburg geboren optische ‘tovenaar’ ook de bedenker was van iets dat hij ‘integrale fotografie’ noemde. Hierbij plaatste hij een array van kleine lensjes in één vlak om er vervolgens foto’s mee te maken. Nu waren er destijds natuurlijk geen computers om het nogal troebele resultaat tot één beeld te smeden. Maar wie eenzelfde lensarray gebruikte om de foto te bekijken, aanschouwde een verbluffend 3D-tafereel. En net als het naar buiten kijken door een raam, veranderde het beeld wanneer de positie van de observator veranderde. In feite was de eerste lightfield camera geboren.

Diepte-informatie

We zoomen weer wat in naar de huidige ‘state-of-the art’. Want hoe zit het vandaag met plenopics? Zoals gezegd heeft een normale lens een specifieke brandpuntsafstand. Dit betekent eigenlijk alleen dat één vlak in de waargenomen 3D ruimte scherp op de gevoelige plaat wordt vastgelegd. Welk vlak dit is, wordt bepaald door de afstand tussen de lens en de beeldsensor. Afhankelijk van welk vlak we in de 3D ruimte scherp willen zien, maken we die afstand groter of kleiner, zodat we precies die ‘doorsnede’ van het tussen lens en sensor zwevende ‘virtuele beeld’ te pakken krijgen, dat we in focus wilden hebben. Maar wat gebeurt er nu wanneer we tussen deze lens en de beeldsensor een lenzenarray van 40.000 microlenzen plaatsen en de hoofdlens zo instellen dat deze net zijn brandpunt achter de beeldsensor heeft liggen? In dat geval kijk je in feite met 40.000 cameraatjes naar het virtuele tussenbeeld van de hoofdlens, die elk een microbeeld op de beeldsensor projecteren. En hoewel de lenzen zeer dicht bij elkaar staan, zullen deze microbeeldjes elkaar niet overlappen (zie figuur 1) en is de afstand groot genoeg om diepte-informatie uit de 40.000 verschillende perspectieven te destilleren. Raytrix heeft bovendien 3 verschillende lenzenarrays met een afwijkende brandpuntsafstand. Dit levert nog meer diepte-informatie op, doordat de ene array het van de andere overneemt zodra het beeld onscherp wordt. Dit principe werkt zo goed, dat zelfs wanneer men iets op zeer grote afstand - zeg 400 meter - wil fotograferen of filmen en dus een flinke telelens moet toepassen met een kleine depth-of-field, er toch een behoorlijk 3D-beeld kan worden opgebouwd.

Resolutie

Een van de grote mankementen van de lightfield camera is de lage effectieve resolutie. Bij standaard plenoptische systemen is deze namelijk maximaal het aantal toegepaste microlenzen. Dus zelfs wanneer men een 16 megapixel sensor toepast, dan blijft deze in het geval van een array van 40.000 microlenzen, beperkt tot 40.000 pixels. Dit is onacceptabel voor veruit de meeste toepassingen. Gelukkig is Raytrix er volgens Christian Perwass in geslaagd de effectieve resolutie te ontkoppelen van het aantal microlenzen en deze daardoor behoorlijk op te krikken. De effectieve beeldresolutie is in hun configuratie tot ongeveer ¼ deel van de sensorresolutie, al is deze nog steeds wel afhankelijk van de afstand van een object tot de camera (zie figuur 2 en 3). In een tijd waar het aantal megapixels bijna dagelijks lijkt toe te nemen, is dat natuurlijk goed nieuws. Zo hebben ze een 42 MP 3D-camera met een effectieve resolutie van 10 megapixels die bij volledige resolutie framerates van 7 fps haalt, maar ook een supersnelle 4 MP 3D-videocamera die bij een effectieve resolutie van 1 megapixel maar liefst 180 frames per seconde aankan. Dit soort getallen zet de deur open naar tal van nieuwe applicaties.

Fotografie en video

Een van de eerste toepassingen die Perwass laat zien, is een 3D face capture. Naast een redelijk scherpe foto van het gezicht van een vrouw - hoe meer structuur het bekeken oppervlak heeft des te meer diepte informatie er is en gelukkig had deze vrouw een gave huid - is er ook een 3D weergave van het gezicht. Door in het 3D-beeld bijvoorbeeld het puntje van de neus aan te klikken, wordt op de foto meteen op de neus scherpgesteld. Het zelfde kan natuurlijk ook voor een oog of een wang. En omdat alle 3D-informatie voorhanden is, kan er achteraf ook met de belichting worden gespeeld. In feite worden de postprocessingsmogelijkheden van de fotograaf behoorlijk uitgebreid, en natuurlijk niet alleen voor het maken van portretten en stilstaand beeld.

Kwaliteitscontrole lastige onderdelen

Een tweede applicatie is wat meer van industriële aard: de kwaliteitscontrole van bijvoorbeeld ‘pinout’ stekkerverbindingen. Zitten alle pinnetjes erin en hebben ze de goede hoogte? Omdat het beeld onder een hoek genomen moet worden en de pinnetjes redelijk diep kunnen liggen, lukt het met een normaal camerasysteem nooit om alles goed in focus te krijgen. Dankzij de extended depth-of-field door het gebruiken van meerdere arrays is dit voor de Raytrix lightfield camera’s geen enkel probleem. Ook voor de inspectie van metalen delen met een fijne structuur zonder gestructureerd licht is lightfield erg geschikt. Helemaal wanneer er steile randen zijn is een dergelijke controle met stereovision of lasertriangulatie lastig te doen.

Flow meten in 3D

Een applicatie die Raytrix met een Deens bedrijf ontwikkelde was het kijken naar de flow deeltjes in vloeistoffen. Hoe bewegen deze deeltjes in 3D? Normaliter had het bedrijf een opstelling met meerdere camera’s nodig om de deeltjesstroom in een met laser uitgelichte waterbak in kaart te kunnen brengen. Door het toepassen van een lightfield camera vervielen de twee overbodig geworden camera’s, wat een aanzienlijke ruimtebesparing opleverde. Ook was de kalibratie er een stuk eenvoudiger op geworden. Dergelijke opstellingen zijn niet alleen nuttig voor vaste deeltjes in water, maar kan ook worden gebruikt om bijvoorbeeld bij het inspuiten de verneveling van de brandstof in de cilinderkop te bestuderen.

Groeianalyse planten

Weer een andere toepassing is het analyseren van de groei van planten. Volgens Perwass is dit een echte groeimark omdat er een onophoudelijke zoektocht is naar sneller groeiende planten en methoden. Wie plantengroei nauwkeurig in beeld wil brengen zal dit in 3D moeten doen. Daarnaast is het natuurlijk van belang de groei niet door de meting te beïnvloeden. Dit betekent dat 3D-visionmethoden die belichting gebruiken voor het verkrijgen van de diepte-informatie eigenlijk geen goede kandidaten zijn. Deze bezwaren gelden niet voor lightfield camera’s.

Cellen in 3D

Tot slot noemt Perwass microscopie. Want met Raytrix R5µ die is uitgerust met een 4MP CMOSIS sensor kan met een lightfield camera 10 keer worden vergroot. Hierbij is de pixelgrootte 5,5 µm, de field of view 1 bij 1 mm en een depth-of-field van 180 µm. Dergelijke specificaties zijn voldoende om al aardig nauwkeurig naar bepaalde onderdelen te kijken. Maar wat Raytrix betreft is dit slechts het begin. Binnen een jaar moet er een camera zijn die maar liefst 100 keer vergroot, waarbij ook cellen met een 3D-camera onder de loep genomen kunnen worden.

Lightfield de beste 3D keuze?

Of lightfield de beste keuze is voor 3D vision is natuurlijk niet gezegd. Zoals eigenlijk bij elke visiontechnologie hangt dit erg af van de toepassing. Zo heeft Time of Flight nog wel eens last in buitentoepassingen en is kijken naar zeer kleine dingen met stereovision geen succes. Zowel lasertriangulatie als stereo kunnen last hebben van occlusie en In het geval van lightfield camera’s kan de resolutie parten spelen. Daarentegen zitten de specs in de lift en worden de megapixels betaalbaarder. Zelfs voor de bij de consumenten populaire Lytro lightfield camera met een effectieve resolutie van 1 Megapixel, is er nu met de Lytro Illum een serieuzer (en prijziger) alternatief. Daarnaast zijn lightfield camera’s robuust, volstaat het gebruik van één camera en is de kalibratie eenvoudig of overbodig. Het heeft meer dan een eeuw geduurd, maar voor wie aan 3D-vision denkt is lightvision zeker een overweging waard.

Dit artikel is eerder verschenen in Vision & Robotics